Hi Rekans,

Uda akhir tahun, masih blom cuti ? kesian deh lo..

Ok biar ga sedih kali ini kita temenin dengan artikel simpel tentang bagaimana membuat solusi chat bot dengan AWS Bedrock, kalau temen-temen belom tau apa itu Bedrock, coba ni dibaca-baca dulu: Build Generative AI Applications with Foundation Models – Amazon Bedrock – AWS

Intinya ini cloud service AWS untuk Generative AI. Bisa generate teks, gambar, dan mungkin yang lain-lain ntar nyusul. Cuman pertanyaannya apakah sudah di support oleh Semantic Kernel ? Nah sekarang udah bisa setelah kita bikinin konektornya. Kalau ketemu awas lo traktir siomey ya.

Ga cuma aplikasi chat, tapi aplikasi yang memanfaatkan text-completion bisa pakai konektor ini, misal buat summary, translate, edit, dsb.

Beberapa model yang di support AWS Bedrock saat ini yaitu:

- Claude

- Amazon Titan

- Llama 2

- Command & Embed

- Stable Diffusion

- Check sendiri dah di webnya

Goalnya, semakin fleksibel library kita untuk bisa terintegrasi dengan berbagai Model LLM yang bagus, semakin banyak pula fitur yang dapat kita manfaatkan dari kapabilitas spesifik dari model tsb.

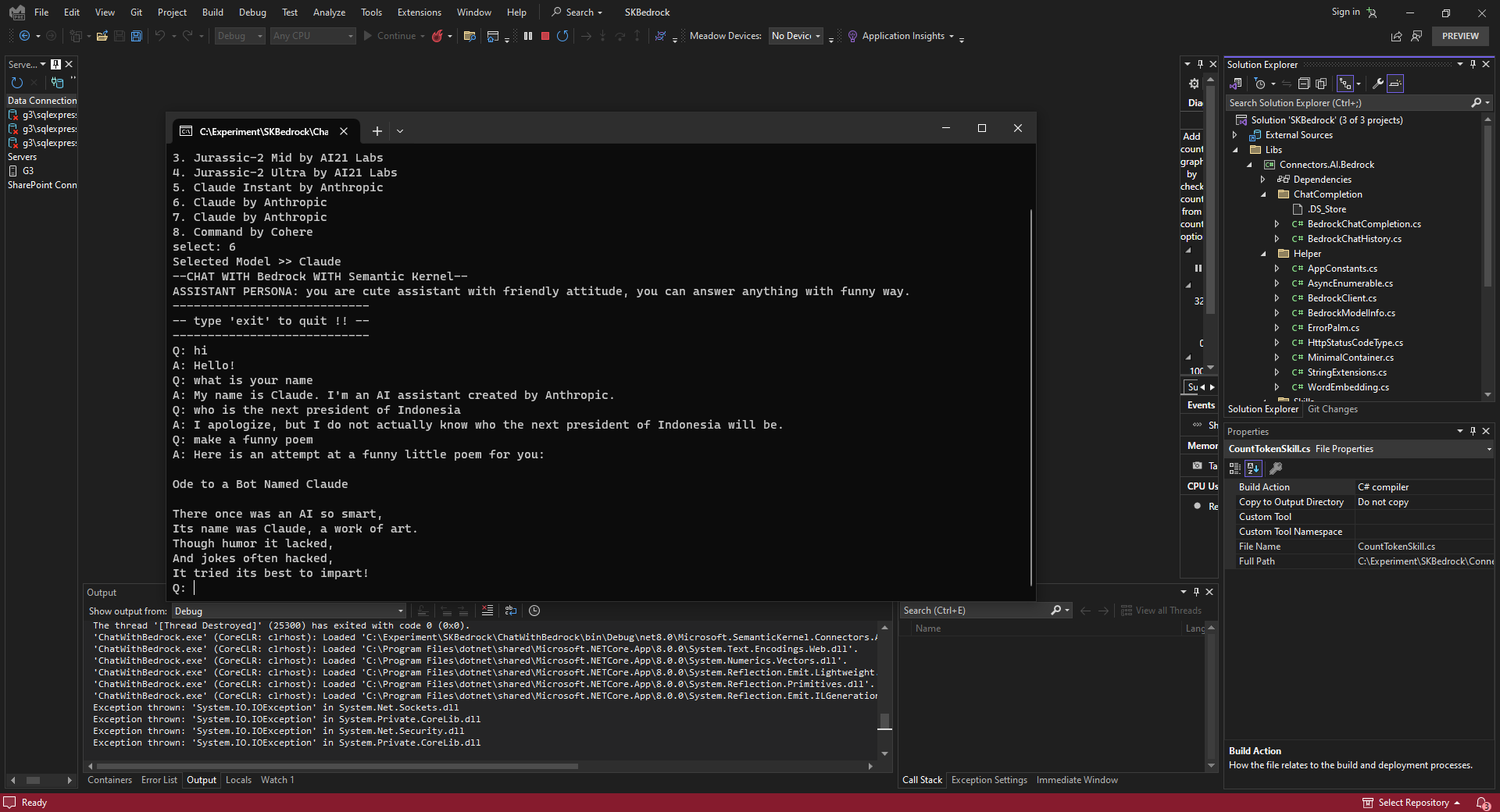

Nah, gimana cara pakenya nih ?

- Install Dotnet dan Visual Studio / VSCode

- Tarik sourcenya dari https://github.com/Gravicode/SKBedrock

- Buka pakai visual studio

- Buka project ChatWithBedrock, terus buka file AppConstants.cs, sesuaikan AccessKey, Secret dan Region yang digunakan di AWS Bedrock

- Yang belum punya akses key, coba baca nih : Creating access keys for the root user – AWS Identity and Access Management (amazon.com)

- Yang belum buka akses ke model LLM, silakan buka Bedrock trus ke menu Model Access, request access deh ke model yang dipengen

- Abis itu jalanin deh..

Ya semoga bermanfaat, selamat berkarya.

Salam Produktif

![]()